JETSON NANOで遊ぶ!【リアルタイム画像類推編】

今回はJetson Nanoでリアルタイム画像類推についてです。

1.jetson-inferenceの構築

Jetson NanoにはGitHubでjetson-inferenceというサンプルがあるので、これを試してみました。

以下の手順で、構築しました。

$ git clone https://github.com/dusty-nv/jetson-inference

$ cd jetson-inference

$ git submodule update –init

$ mkdir build

$ cd build

$ cmake ../

$ make

$ sudo make install

$ sudo reboot

2.サンプルを試す

$ cd jetson-inference/build/aarch64/bin

・ペットボトルが検出されるか?

$ ./detectnet-camera –camera=/dev/video0 –network=googlenet coco-bottle

以下は、結果画像です。77%の割合で検出されました。

・ペットボトルがどのように認識されるか?

$ ./imagenet-camera –camera=/dev/video0 –network=googlenet

以下は、結果画像です。23,25%の割合で薬箱もしくは常備薬戸棚として認識されました。(笑)

面白いですね~。

3.自分作成済のものを試す

それでは、昔PC上で私がちょっと作成してみたもの(一部)もJetson Nanoに落として、試してみます。

※python3で開発したもの。

・物体認識

以下が結果画像です。

丸で色のついた部分で物体認識されているようです。

※本当は動画で物体が動く軌跡が描かれるんですが、動画サイズが重いので割愛。

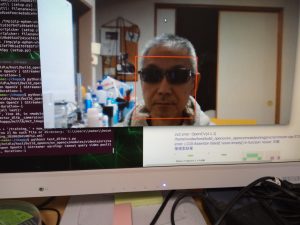

・顔認識

以下が結果画像です。

赤の四角で顔が囲まれていて認識されています。

必要なpython3のライブラリをインストールする必要がありましたが、ちゃんと動作しました。

次回はTensorflowをインストールして何か作成してみようと思います。

※最終的にはJetBotを試してみたいです。

最近のコメント